Upload README.md with huggingface_hub

Browse files

README.md

ADDED

|

@@ -0,0 +1,101 @@

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| 1 |

+

---

|

| 2 |

+

license: apache-2.0

|

| 3 |

+

datasets:

|

| 4 |

+

- dichspace/darulm

|

| 5 |

+

- HuggingFaceFW/fineweb-2

|

| 6 |

+

- RefalMachine/ruadapt_hybrid_instruct

|

| 7 |

+

- t-tech/T-Wix

|

| 8 |

+

language:

|

| 9 |

+

- ru

|

| 10 |

+

- en

|

| 11 |

+

base_model:

|

| 12 |

+

- Qwen/Qwen3-8B

|

| 13 |

+

---

|

| 14 |

+

<p align="left">

|

| 15 |

+

<a href="https://jle.hse.ru/article/view/22224"><b>Paper Link</b>👁️</a>

|

| 16 |

+

<br>

|

| 17 |

+

<a href="https://huggingface.co/RefalMachine/RuadaptQwen3-8B-Hybrid-GGUF"><b>GGUF</b>🚀</a>

|

| 18 |

+

</p>

|

| 19 |

+

<hr>

|

| 20 |

+

|

| 21 |

+

# RU

|

| 22 |

+

## Описание модели

|

| 23 |

+

|

| 24 |

+

**Ruadapt** версия модели **Qwen/Qwen3-8B** c **гибридным ризонингом**. В модели был заменен токенизатор, затем произведено дообучение (Continued pretraining) на русскоязычном корпусе, после чего была применена техника **LEP (Learned Embedding Propagation)**.

|

| 25 |

+

|

| 26 |

+

Благодаря новому токенизатору (расширенный tiktoken cl100k с помощью униграм токенизатора на 48 т. токенов) скорость генерации* русскоязычных текстов возрасла **до 100%** (в зависимости от длины контекста) по сравнению с исходной моделью.

|

| 27 |

+

|

| 28 |

+

**Под скоростью генерации подразумевается количество русскоязычных символов/слов в секунду на одинаковых текстовых последовательностях.*

|

| 29 |

+

|

| 30 |

+

## Важно

|

| 31 |

+

|

| 32 |

+

**Веса модели могут обновляться** по мере получения новых версий. Информацию о версиях будет в самом конце README, там же фиксируются **даты** и **коммиты** версий, чтобы всегда можно было использовать предыдущие варианты при необходимости.

|

| 33 |

+

|

| 34 |

+

Ответы модели не отражают мнения авторов, а лишь повторяют знания полученные из данных на всех этапах обучения (предобучение, смена токенизатора, обучение на инструкциях, калибровка качества ответов). Модель была получена из сторонней предобученной модели, **контроль за предобучением** которой **не является ответственностью текущих авторов**. При создании данной версии модели не производилось никаких дополнительных действий, направленных на изменение заложенных в LLM "мнений". Используйте с осторожностью.

|

| 35 |

+

|

| 36 |

+

## Гибридрый ризонер

|

| 37 |

+

|

| 38 |

+

Модель, как и ее исходная версия, является гибридным ризонером. По умолчанию модель работает с включенным режимом размышлений.

|

| 39 |

+

Чтобы отключить режим рассуждений, добавьте в конец последнего сообщения токен /no_think.

|

| 40 |

+

Чтобы обратно его включить, добавьте /think.

|

| 41 |

+

|

| 42 |

+

Альтернативный способ при работе с моделью напрямую:

|

| 43 |

+

```python

|

| 44 |

+

text = tokenizer.apply_chat_template(

|

| 45 |

+

messages,

|

| 46 |

+

tokenize=False,

|

| 47 |

+

add_generation_prompt=True,

|

| 48 |

+

enable_thinking=False # Setting enable_thinking=False disables thinking mode

|

| 49 |

+

)

|

| 50 |

+

```

|

| 51 |

+

|

| 52 |

+

## Рекомендуемые параметры генерации

|

| 53 |

+

Для более стабильной работы рекомендуется использовать низкие температуры 0.0-0.3, top_p в диапазоне от 0.85 до 0.95 и repetition_penalty 1.05 (зависит от задач, но если уходит в циклы, то пробуйте поднять repetition_penalty. В случае же RAG, возможно наоборот снизить до 1.0).

|

| 54 |

+

|

| 55 |

+

## Метрики

|

| 56 |

+

|

| 57 |

+

|

| 58 |

+

|

| 59 |

+

|

| 60 |

+

|

| 61 |

+

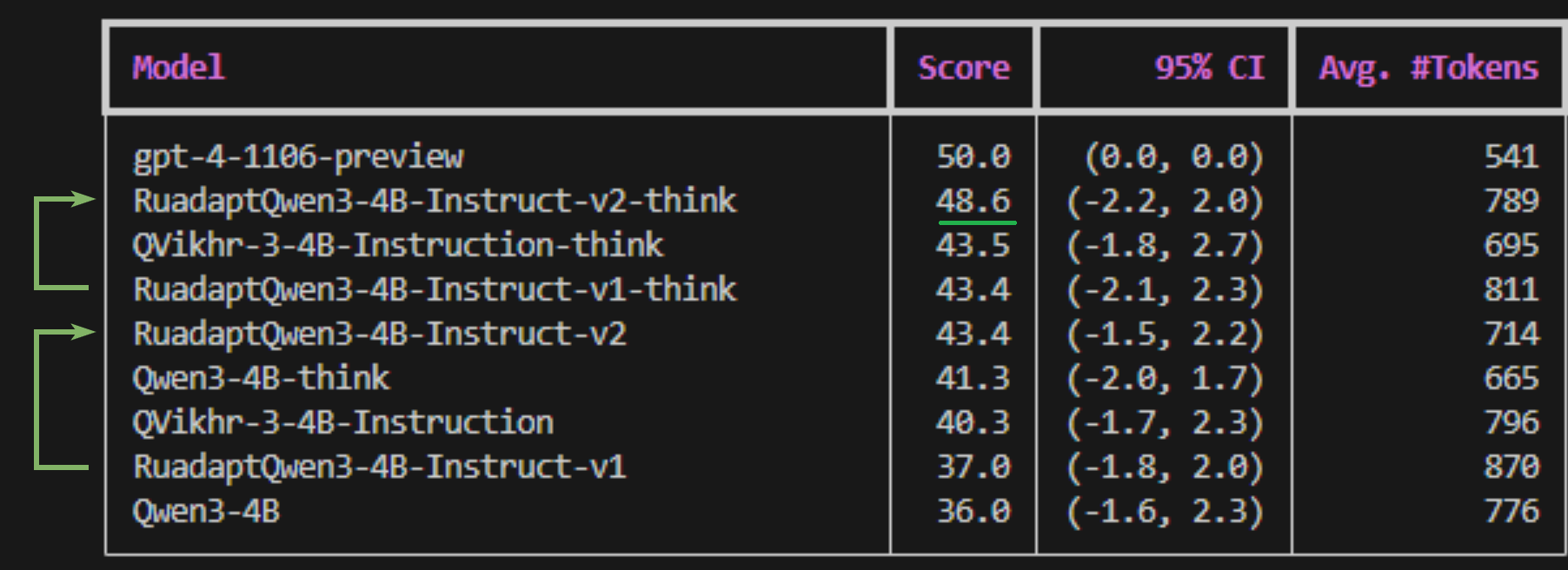

*Рейтинг на считался на Vikhrmodels/arenahardlb с использованием DeepSeek-V3-0324 в качестве оценщика против модели gpt-4-1106-preview с включенным length-control.

|

| 62 |

+

|

| 63 |

+

|

| 64 |

+

|

| 65 |

+

# EN

|

| 66 |

+

|

| 67 |

+

## Model Description

|

| 68 |

+

|

| 69 |

+

**Ruadapt** version of **Qwen/Qwen3-4B**.

|

| 70 |

+

In this model the tokenizer was replaced, followed by continued pre-training on a Russian-language corpus, after which the **LEP (Learned Embedding Propagation)** technique was applied.

|

| 71 |

+

|

| 72 |

+

Thanks to the new tokenizer (an extended tiktoken cl100k, augmented with a 48 k russian tokens), the generation speed* of Russian-language texts has increased **by up to 100 %** (depending on context length) compared with the original model.

|

| 73 |

+

|

| 74 |

+

*Generation speed is understood as the number of Russian characters/words produced per second on identical text sequences.*

|

| 75 |

+

## Important

|

| 76 |

+

|

| 77 |

+

The model may be updated as new versions become available. Version information is provided at the very end of the README, where **dates** and **commits** are logged so that previous versions can always be used if necessary.

|

| 78 |

+

|

| 79 |

+

The model’s answers do not reflect the authors’ opinions; they merely reproduce the knowledge obtained from data at all training stages (pre-training, tokenizer replacement, instruction tuning, answer-quality calibration). The model is based on a third-party pretrained model, and **the current authors are not responsible for its initial pre-training**. No additional actions were taken to modify the “opinions” embedded in the LLM while creating this version. Use with caution.

|

| 80 |

+

|

| 81 |

+

<hr>

|

| 82 |

+

|

| 83 |

+

# Other

|

| 84 |

+

|

| 85 |

+

## Tokenization

|

| 86 |

+

|

| 87 |

+

|

| 88 |

+

|

| 89 |

+

|

| 90 |

+

|

| 91 |

+

## Versions

|

| 92 |

+

|

| 93 |

+

v1:

|

| 94 |

+

- [b827af5797f263245939190dc1e4fd54565b3405](https://huggingface.co/RefalMachine/RuadaptQwen3-8B-Hybrid/commit/b827af5797f263245939190dc1e4fd54565b3405)

|

| 95 |

+

- Внутреннее имя/Alias: RuadaptQwen3-8B-Hybrid-v1

|

| 96 |

+

- Дата/Date: 26.08.2025

|

| 97 |

+

|

| 98 |

+

|

| 99 |

+

## How to cite:

|

| 100 |

+

|

| 101 |

+

Tikhomirov M., Chernyshov D. Facilitating Large Language Model Russian Adaptation with Learned Embedding Propagation //Journal of Language and Education. – 2024. – Т. 10. – №. 4. – С. 130-145.

|